Die richtige Entscheidung im Notfall Ethik-Kommission äußert sich zu selbstfahrenden Autos

Berlin · Was dürfen selbstfahrende Autos entscheiden? Aus ethischer Sicht zählt jedes Menschenleben gleich viel.

Wie soll ein Auto reagieren, das selbstständig fährt und in ein Dilemma gerät: Eine Gruppe Kinder und eine alte Dame versperren unvermittelt die Fahrbahn, der Bremsweg ist zu lang, ein Zusammenstoß mit Personen unvermeidlich. Wem soll das Auto ausweichen, wem nicht?

Dies war eine der heikelsten Fragen zum automatisierten Fahren, die sich die 14 Mitglieder einer Ethikkommission im Bundesverkehrsministerium in den vergangenen Monaten stellen mussten. Die Juristen, Ingenieure und Vertreter von Volkswagen, Daimler und dem ADAC sowie ein Philosoph, ein Theologe und ein Verbraucherschützer formulierten als Ergebnis ihrer Debatten 20 Thesen, die als Leitplanken für künftige Gesetze dienen könnten.

Oberstes Gebot: Autos sollten sich nur dann völlig selbstständig bewegen dürfen, wenn das die Sicherheit auf den Straßen erhöhe. Zu diesem Schluss kam die Expertengruppe um den ehemaligen Verfassungsrichter Udo di Fabio. Bis allerdings vollständig autonom fahrende Autos serienreif sind, die also überhaupt keinen Fahrer mehr benötigen und ihre Insassen nach Belieben chauffieren, dürften noch viele Jahre vergehen.

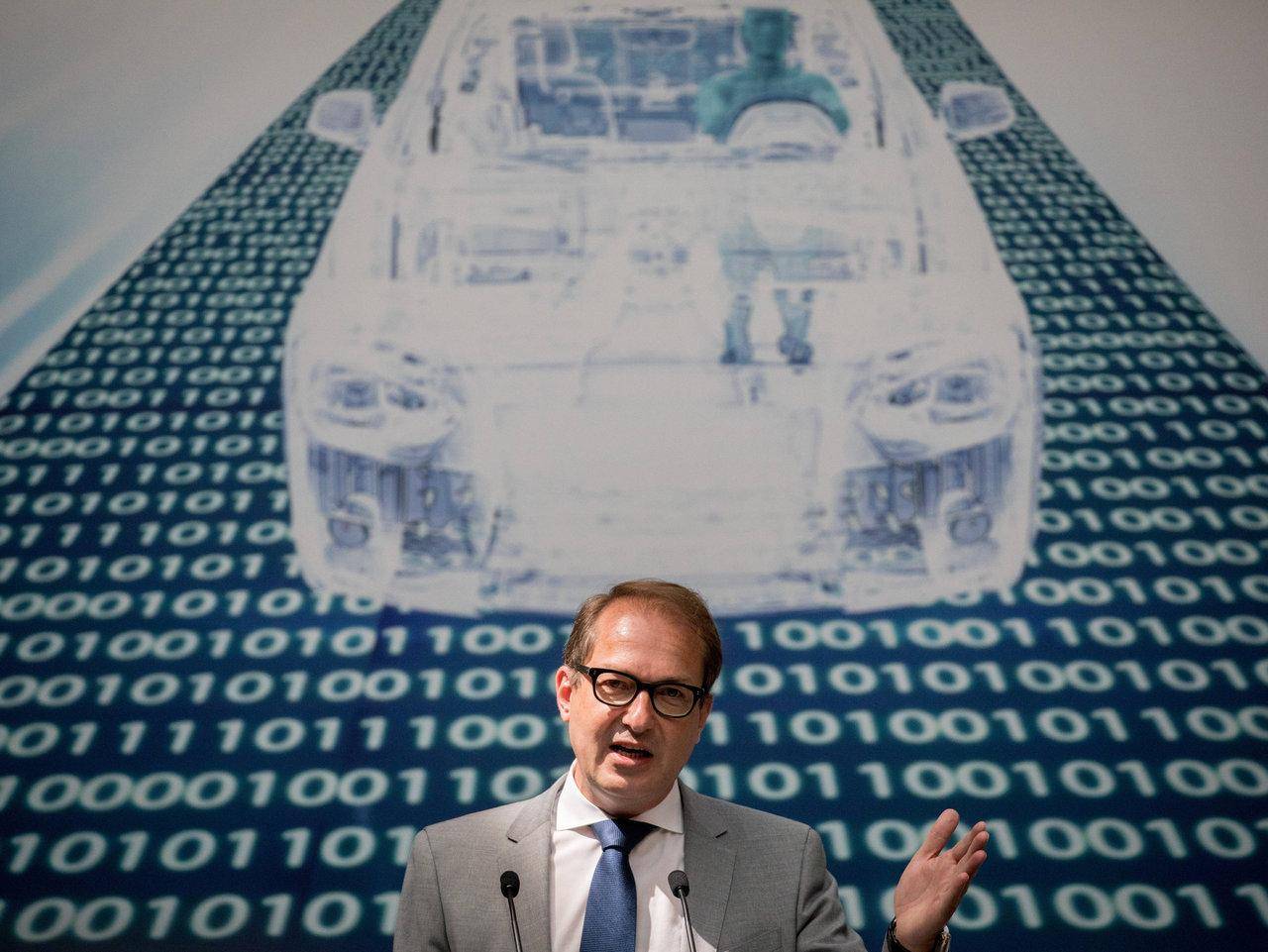

Fahrzeuge mit entsprechenden Vorstufen wie dem hochautomatisierten Fahren könnten hingegen schon in etwa fünf Jahren beim Händler stehen, wie Bundesverkehrsminister Alexander Dobrindt (CSU) prognostizierte. Solche Autos, die zum Beispiel als Testwagen auf der Autobahn 9 unterwegs sind, nehmen dem Fahrer in bestimmten Situationen auf Knopfdruck nahezu alle Aufgaben ab – weit mehr als die bereits verfügbaren Assistenten zum Einparken, Spurhalten und Notbremsen. Das nächste Level wäre erreicht, wenn sich Autos im Verkehr voll automatisiert bewegen, der Fahrer aber jederzeit das Steuer übernehmen könnte. Die Königsdisziplin wäre schließlich ein autonomes Fahrzeug ganz ohne Lenkrad.

Di Fabio betonte allerdings, dass sich die ethischen Fragen auch jetzt schon stellten. Im Kern der Überlegungen steht die Software des Autos, gewissermaßen dessen Betriebssystem. Dafür haben di Fabio und die anderen Kommissionsmitglieder Grundsätze formuliert. Demnach muss der gesamte Betrieb des Autos auf Unfallvermeidung ausgerichtet sein. Lässt sich ein Zusammenprall aber nicht vermeiden, muss das Auto immer einen Sach- oder Tierschaden vorziehen, wenn sich dadurch ein Personenschaden vermeiden lässt. Soweit so eingängig.

Uneins blieben die Experten aber in der Frage nach der Dilemma-Situation, wenn ein Personenschaden unvermeidbar ist. Dann dürfen mögliche Opfer nicht nach Alter, Geschlecht und anderen persönlichen Merkmalen unterschieden werden, sagte di Fabio. Jedes Menschenleben zähle gleich viel. Keine Auto-Software dürfe Hierarchien für die augenblickliche Abwägung im Notfall enthalten, so der Jurist. Wichtig ist zudem der Kontext: Gerät ein Autofahrer in das beschriebene Dilemma und entscheidet er sich dafür, den Kindern statt der alten Dame auszuweichen, würde ihm wohl kein Strafrichter Probleme bereiten – sofern er keine Schuld an der Unfallursache trägt. Eine Programmierung hingegen, so sehen es Experten der Kommission, dürfe es auch deswegen nicht geben, weil der jeweilige Kontext nicht vorhersehbar sei.

Für weitere Diskussion sorgte die Frage, wer bei einem Unfall haftet? Klar: Der Fahrer, wenn er am Steuer ist. Ab dem Moment, in dem das Auto übernimmt, soll jedoch der Auto- oder Softwarehersteller haften. Diese kommen auch bei der Datensouveränität ins Spiel. Justizminister Heiko Maas (SPD) sagte unserer Redaktion: „Der Kunde muss ganz bewusst entscheiden können, welche Daten er Preis gibt und was mit seinen Daten passiert. Er darf nicht zum reinen Objekt der Technik werden.“ Der Fahrer müsse die Datenübermittlung kontrollieren können. Dann gehöre dem automatisierten Fahren die Zukunft, so Maas.